Adobe, la société à l’origine de grands programmes créatifs comme Photoshop et Premiere, vient de terminer son discours d’ouverture Adobe Max 2025, et vous savez ce que cela signifie. C’est vrai : plus d’IA. Au cours de la présentation de trois heures, la société a mis l’accent sur l’automatisation de la créativité, en introduisant de nouveaux outils d’IA générative pour Photoshop, Lightroom, Premiere Pro et d’autres applications Creative Cloud. Certains d’entre eux sont des extensions d’outils qui existent déjà, comme un meilleur remplissage génératif, tandis que d’autres sont tous nouveaux, comme la nouvelle génération audio AI de Firefly.

Adobe Express peut concevoir en fonction des vibrations

Avant d’entrer dans le vif du sujet, commençons par les applications d’entrée de gamme d’Adobe. Bien qu’Adobe soit connu pour ses programmes de niveau professionnel comme Photoshop, la société dispose également de son propre éditeur Web de base gratuit (bien qu’il existe également une application mobile) pour l’aider à rivaliser avec des alternatives comme Canva. Appelé Adobe Express, l’outil a fait l’objet d’un flux constant de mises à niveau depuis ses débuts en 2015 et, avec l’introduction de l’IA générative, il a rapidement suivi la tendance pour essayer de se rendre plus facile à utiliser.

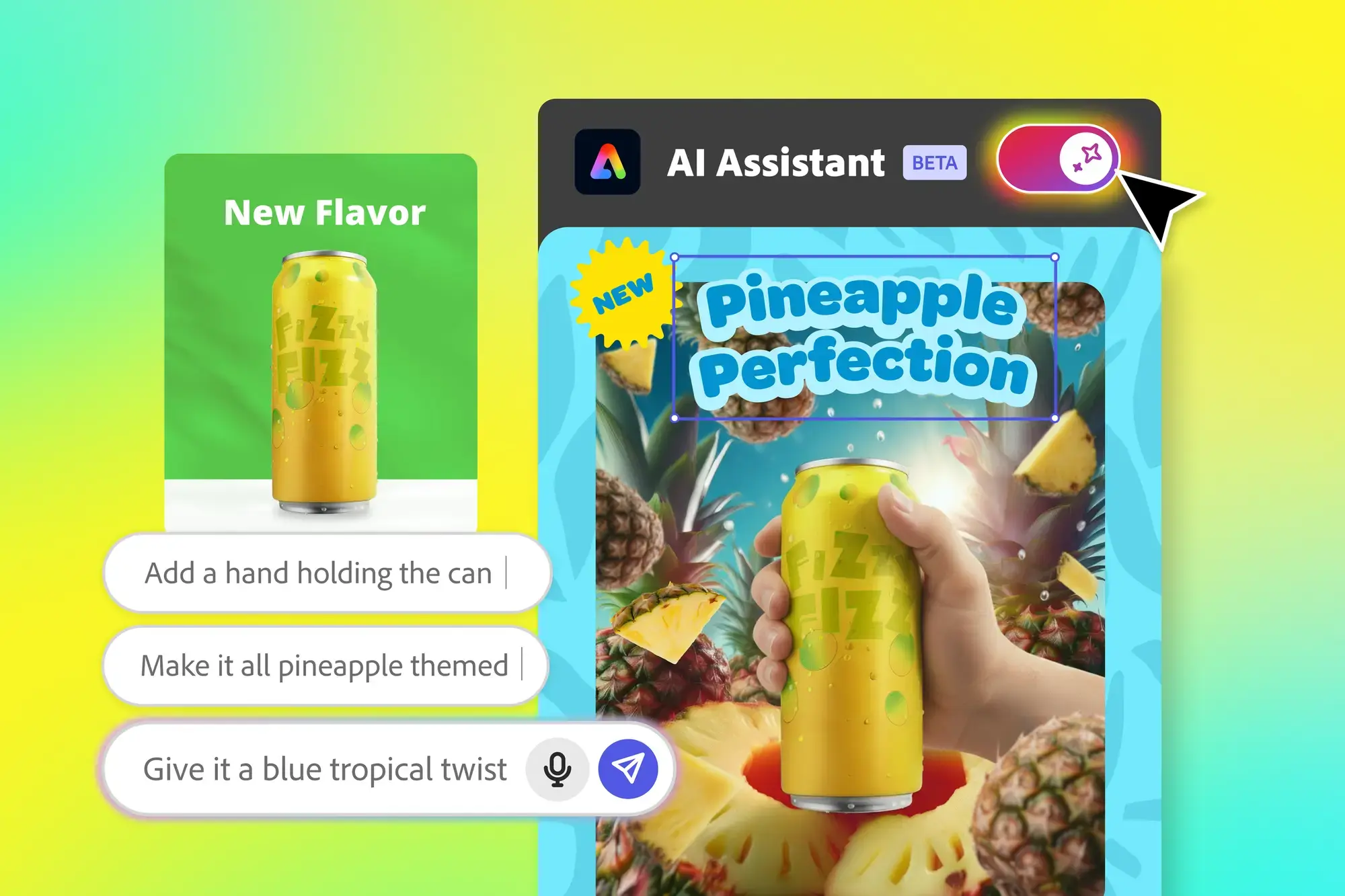

Entrez dans « AI Assistant dans Adobe Express » d’aujourd’hui. Lorsqu’il est activé via un commutateur dans le coin supérieur gauche de l’application, l’assistant remplacera vos outils par une boîte de discussion dans laquelle vous pourrez lui demander de créer un nouveau design à partir de zéro ou d’en modifier un existant. Si vous avez à nouveau besoin de vos outils, vous pouvez les restaurer en désactivant l’assistant, bien que les démos d’Adobe pour la fonctionnalité montrent également que l’assistant affiche des curseurs contextuels en cas de besoin, comme un pour le redimensionnement.

Bien qu’il ne s’agisse pas de la première aventure d’Adobe Express dans le domaine de l’IA générative, l’idée est de rendre le démarrage ou l’édition rapide d’un élément moins intimidant, en permettant aux utilisateurs inexpérimentés de passer la plupart de leur temps dans une boîte de discussion plutôt que de devoir cliquer sur une barre d’outils. Adobe affirme que, comme ses autres outils d’IA, il s’appuie sur un certain nombre de sources « commercialement sûres », notamment les bibliothèques de polices et d’images de stock de l’entreprise et ses modèles Firefly AI.

L’outil commencera à être déployé en version bêta publique aujourd’hui, vous devriez donc pouvoir l’essayer sous peu.

Adobe Premiere est intégré à YouTube Shorts

Les courts métrages sont la prochaine grande nouveauté sur YouTube, et pour encourager davantage de personnes à les créer, YouTube s’associe à Adobe. En tant que mise à jour de l’application Premiere pour iPhone et de YouTube lui-même, la nouvelle fonctionnalité Adobe Create for YouTube Shorts vous permet de télécharger vos séquences et de les préparer instantanément pour la publication avec les superpositions de polices d’Adobe et un certain nombre d’effets, de transitions et d’autocollants « exclusifs ». Vous pouvez également connecter directement vos images à des modèles contenant déjà des transitions et des effets.

La fonctionnalité est actuellement répertoriée comme « à venir », il vous faudra donc un peu de temps avant de pouvoir l’essayer. Mais une fois qu’il sera en ligne, Adobe et YouTube indiquent que vous pourrez y accéder soit via l’application iPhone Premiere, soit directement via YouTube, via une icône « Modifier dans Adobe Premiere » dans les courts métrages YouTube.

Il n’y a pas encore de mot sur une version Android ou de bureau.

Adobe ajoutera du son à vos vidéos pour vous

Le son est facile à négliger lors de la création d’une nouvelle vidéo, et j’ai dû me démener pour trouver une bande-son décente à ajouter à mes vidéos à la dernière seconde plus d’une fois. Les nouvelles fonctionnalités audio Firefly AI d’Adobe cherchent à vous sauver de ce sort, en facilitant l’ajout de musique et même de narration à une vidéo autrement silencieuse.

Déployés en version bêta publique aujourd’hui, les nouveaux boutons « Générer la bande-son » et « Générer la parole » de Firefly utilisent l’IA et un système d’invite de style Mad Libs pour vous aider à évaluer rapidement votre contenu à partir d’un certain nombre d’options.

Pour « Générer une bande-son », vous téléchargerez votre vidéo, appuyez sur le bouton approprié et l’application vous proposera une invite et vous proposera une palette d’adjectifs, de types de genre et de types de contenu pour l’affiner. Faites glisser les termes que vous avez choisis dans la zone d’invite, cliquez sur Générer et vous obtiendrez quatre options, chacune d’une durée maximale de cinq minutes.

Il est un peu étrange que vous ne puissiez pas simplement saisir vos propres termes dans la boîte de dialogue, bien que Alexandru Costin, responsable de l’IA générative d’Adobe, ait déclaré à The Verge que c’est parce que l’audio de l’IA est « un nouveau muscle que nous devons développer » et que l’approche actuelle est « plus facile et plus accessible ».

Comme les autres générations de Firefly, l’audio sera généré à l’aide du contenu sous licence d’Adobe, de sorte que les utilisateurs n’auront pas à s’inquiéter des atteintes aux droits d’auteur sur les vidéos réalisées à l’aide de cette fonctionnalité.

« Generate Speech », quant à lui, permet aux utilisateurs d’accéder à plus de 50 voix de synthèse vocale, soit à partir d’Adobe Firefly, soit sous licence via ElevenLabs. Il n’y a pas d’invite Mad Libs ici, Adobe permettant à la place un contrôle précis de facteurs tels que la vitesse, la hauteur, la tonalité et même la prononciation. Actuellement, plus de 20 langues sont prises en charge.

Prises ensemble, les mises à jour me semblent être une tentative de suivre le rythme des plateformes comme Instagram et TikTok, qui intègrent des bibliothèques musicales sous licence et une synthèse vocale. Il reste à voir si une version purement alimentée par l’IA peut suivre, bien que la mettre dans l’éditeur plutôt que sur la plateforme donne aux créateurs plus de choix quant à l’endroit où télécharger.

Mises à jour dans Photoshop, Lightroom et Premiere

Enfin, pour les utilisateurs Adobe les plus inconditionnels, des mises à jour seront également apportées aux applications principales de l’entreprise.

Premièrement, Photoshop dispose également de son propre assistant IA, qui pourra utiliser des invites pour modifier pour vous. Cependant, contrairement à Adobe Express, il est actuellement en version bêta privée, il faudra donc un certain temps avant que la plupart des utilisateurs ne le voient. Elle est également limitée à la version Web de l’application pour le moment.

Cependant, la version bêta ne permet pas de choisir les modèles d’IA avec lesquels l’application fonctionne. Auparavant, Generative Fill, qui utilise l’IA pour remplir des espaces vides dans les arrière-plans (ou simplement générer des toiles entières à partir de rien), était limité aux modèles Firefly d’Adobe. Désormais, les utilisateurs pourront également les utiliser avec le modèle Gemini 2.5 Flash de Google ou le modèle Flux.1 Kontext de Black Forest. Compte tenu de la popularité de Flash 2.5 sur les réseaux sociaux sous le nom de « nano banane », c’est un gros avantage pour Adobe.

Pourtant, Firefly n’est pas en reste. Adobe affirme avoir mis à niveau le modèle avec la possibilité de générer dans une résolution native de quatre mégapixels et de mieux restituer les personnes. Il l’intègre également dans un nouvel outil « Édition d’images en couches » qui peut apporter des modifications contextuelles pour vous sur les calques, comme jouer avec les ombres après avoir déplacé une image.

En dehors de Photoshop, Lightroom dispose de sa propre fonctionnalité bêta privée appelée « Assisted Culling ». J’admets que Lightroom est probablement l’endroit où j’ai le moins d’expérience en matière d’Adobe, mais la société affirme qu’elle sera en mesure de filtrer les photos téléchargées pour vous et de trouver les plus faciles à modifier.

Enfin, Premiere Pro possède sa propre fonctionnalité bêta, mais gracieusement publique. Appelé « AI Object Mask », il détectera et suivra automatiquement les personnes et les objets en arrière-plan de votre vidéo, afin que vous puissiez ajouter plus facilement des effets tels que des flous ou un étalonnage des couleurs. Cela peut être utile si, par exemple, vous photographiez dans une zone très fréquentée où vous devez flouter de nombreux visages.

Un petit quelque chose pour tout le monde

Dans l’ensemble, c’était un Max assez équilibré, avec un certain nombre de fonctionnalités pour les pros et les débutants. Cela dit, je ne peux ignorer l’accent mis sur l’IA et la génération automatique. D’un côté, je trouve que Photoshop est un peu intimidant. D’un autre côté, plus Adobe gère vos modifications à votre place, plus il court le risque de concurrencer les applications et plates-formes d’édition faciles existantes. Je suis curieux de voir comment le géant de l’industrie sera compétitif alors que des plateformes comme TikTok et Instagram continuent de proposer leurs propres outils d’édition intégrés.