De nombreux enseignants ne sont pas satisfaits de la révolution de l’IA, et il est difficile de leur en vouloir : ChatGPT a prouvé que vous pouvez envoyer une invite à l’IA, par exemple pour un devoir de lycée, et que l’IA peut cracher un résultat en quelques secondes. Bien sûr, cet essai peut être truffé d’erreurs, mais bon, les devoirs sont faits. Ainsi, lorsque les contrôleurs d’IA se présentent comme une nouvelle ligne de défense contre la triche de l’IA, il est logique que toute personne concernée commence à les utiliser. Le problème est qu’ils ne sont pas parfaits et que ces imperfections nuisent aux gens.

Comment fonctionnent les détecteurs IA

Tous les programmes d’IA actuellement populaires (par exemple, ChatGPT) sont basés sur de grands modèles de langage (LLM). Les LLM sont formés sur énorme quantités de texte et exploitez ces connaissances pour vous répondre. En termes simples, tout ce que fait l’IA, c’est prédire quel mot devrait suivre la dernière chose qu’elle a dite, en fonction de ce qu’elle sait grâce à son entraînement. Il ne sait pas ce que signifie « la neige est froide, mais le feu est chaud », mais il sait que « chaud » suit souvent « le feu est ». (Encore, super explication simpliste.)

Les vérificateurs d’IA fonctionnent de la même manière : ils sont formés sur des ensembles de données de texte, certains écrits par des humains, d’autres par des robots, et certains écrits par les deux. Les détecteurs d’IA recherchent des signes révélateurs du texte généré par les LLM, tels que le langage répétitif, la probabilité de choix de mots et le ton. Tout comme vous espérez entraîner une IA à reconnaître des modèles, les développeurs espèrent également que les vérificateurs d’IA pourront reconnaître si le texte a été écrit par un robot ou non.

Ces développeurs affirment que leurs contrôleurs peuvent le faire. Mais je n’en suis pas si sûr. En fait, j’ai demandé à ChatGPT s’il pouvait ou non reconnaître si un texte donné avait été écrit par une IA ou par un humain. Il a répondu :

En tant que modèle de langage d’IA, je peux générer un texte qui peut être difficile à distinguer du texte écrit par un humain. Cependant, il n’est pas toujours possible de déterminer avec certitude si un texte a été généré par une IA ou écrit par un humain, surtout si le texte a été bien écrit et édité.

Certains indicateurs peuvent suggérer si un texte a été généré par l’IA, tels que des modèles inhabituels ou répétitifs, un manque de cohérence ou des choix de vocabulaire inhabituels. Cependant, ces indicateurs ne sont pas toujours présents et peuvent être surmontés grâce à des technologies avancées d’IA.

Il convient également de noter que la qualité du texte généré par l’IA s’améliore constamment, de sorte qu’il pourrait devenir de plus en plus difficile de faire la distinction entre le texte généré par l’homme et celui généré par l’IA à l’avenir. En fin de compte, la meilleure façon de déterminer si un morceau de texte a été généré par l’IA est de le faire analyser attentivement par un expert qualifié dans le domaine.

Ce n’est pas vraiment un soutien élogieux de la part du parrain des robots IA. Mais regardons comment ces détecteurs résistent en action :

Comment fonctionnent les détecteurs d’IA dans la nature

Turnitin, dont je me souviens avoir inspiré la peur pour son vérificateur de plagiat, affirme que son logiciel détecte désormais le contenu généré par l’IA avec une confiance de 98 %. Si c’est vrai, c’est sans aucun doute élevé. BestColleges a testé le logiciel, capable de faire la distinction entre l’écriture générée par l’homme, celle générée par l’IA et l’écriture hybride. Mais même cette statistique signifie qu’un enseignant accusera à tort un élève sur 50 d’utiliser des outils d’IA pour tricher.

L’expérience du Washington Post avec Turnitin est cependant plus accablante que cela. Les étudiants ont aidé le Post à proposer 16 échantillons d’écriture composés de textes générés par l’homme, générés par l’IA et hybrides. En fin de compte, Turnitin a obtenu plus de la moitié des échantillons au moins en partie incorrects. Il en a correctement marqué six, mais a complètement laissé tomber la balle sur trois autres. S’il s’agissait d’un vrai cours, Turnitin n’aurait produit qu’un désastre.

L’un des premiers générateurs d’IA à devenir viral, GPTZero, échoue au test de précision avec peu d’expérimentation. Je l’ai testé en écrivant un paragraphe sur la glace sur un ton neutre. Il m’a dit « Votre texte sera probablement entièrement écrit par l’IA. »

La crème glacée est un dessert glacé populaire apprécié par les gens du monde entier. Il est principalement consommé par temps chaud ou chaud, comme en été, mais il se déguste toute l’année. La crème glacée se décline en de nombreuses saveurs et est souvent accompagnée de garnitures, telles que des bonbons, des noix, des fruits ou des sirops.

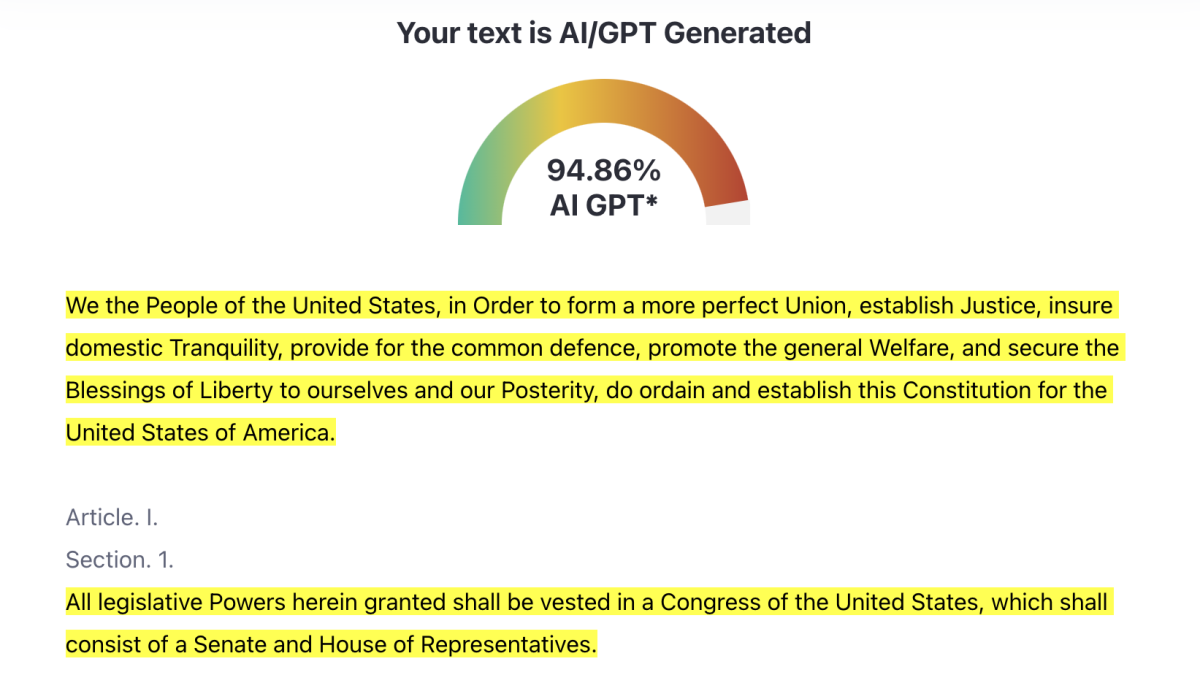

Mais mon paragraphe ambigu n’est qu’un début. Un autre détecteur, nommé ZeroGPT, qui prête à confusion, est tombé sur la face lorsqu’un rédacteur a décidé d’analyser la Constitution des États-Unis. Selon ZeroGPT, la Constitution a été rédigée à 92,26 % par AI. Qui aurait cru que la Convention de Philadelphie s’appuyait autant sur l’intelligence artificielle pour élaborer la loi du pays ? (Je suppose que cela explique de toute façon quelques-uns de ces amendements.)

Ce Tweet est actuellement indisponible. Il est peut-être en cours de chargement ou a été supprimé.

Cependant, une façon de tromper les détecteurs consiste à faire passer un texte généré par l’IA à un autre passage via l’IA. QuillBot, par exemple, réécrit le texte pour vous et est déjà utilisé par les étudiants pour échapper aux contrôleurs. Si un détecteur d’IA recherche la « moyenne » d’un texte donné afin de déterminer s’il a été écrit par une IA ou non, demander à une autre IA d’ajouter plus de variété au texte mettra une clé dans ce système. QuillBot apparaît fréquemment dans les commentaires de TikToks discutant des détecteurs d’IA à l’école. Les enfants volonté trouver un moyen.

Les détecteurs d’IA blessent des étudiants innocents

Jusqu’à présent, ces exemples ne sont que de la théorie. Mais ces dames ne sont pas des prototypes. Ils sont là et sont utilisés contre de vrais étudiants. Je suis sûr que ces détecteurs ont dénoncé de nombreux étudiants qui utilisaient des outils comme ChatGPT pour tricher, mais ils accusent également à tort des étudiants innocents de faire de même, et cela a des conséquences néfastes :

Ce Tweet est actuellement indisponible. Il est peut-être en cours de chargement ou a été supprimé.

Ce tweet a eu une « bonne » résolution, puisque l’instructeur a reconnu l’erreur et a retiré son accusation. Mais dans d’autres situations, les enseignants traitent les vérificateurs d’IA comme un évangile, mettant fin à la discussion avec chaque résultat « généré par l’IA » :

Ce Tweet est actuellement indisponible. Il est peut-être en cours de chargement ou a été supprimé.

Je ne nierai pas que nous sommes confrontés à un nouveau monde. Les grands modèles linguistiques signifient que les étudiants peuvent brancher une invite de rédaction et recevoir en retour un essai entièrement écrit (avec différents niveaux de qualité). Mais peut-être que le fait que les étudiants puissent si facilement tromper le système indique un système qui doit changer, plutôt qu’une solution de fortune qui punit les étudiants innocents aussi facilement que les coupables.

Turnitin qualifie de « faux positifs » les moments où il qualifie le texte généré par l’homme d’écrit par l’IA. Mignon. Mais l’entreprise souligne qu’elle « ne détermine pas une mauvaise conduite » ; ils proposent plutôt donnéeset laissez le dernier appel à l’éducateur. Cet avertissement semble avoir été perdu pour beaucoup : à leurs yeux, si le vérificateur de l’IA dit que vous êtes un tricheur, vous êtes un tricheur.