Les chatbots, de par leur nature, sont des machines de prédiction. Lorsque vous obtenez une réponse de quelque chose comme Claude AI, il peut sembler que le bot engage dans une conversation naturelle. Cependant, à la base, tout ce que le bot fait est vraiment de deviner quel devrait être le mot suivant dans la séquence.

Malgré cette fonctionnalité fondamentale, les entreprises d’IA explorent comment les robots eux-mêmes réagissent aux interactions humaines, en particulier lorsque les humains s’engagent négativement ou de mauvaise foi. Anthropic, l’entreprise derrière Claude, travaille maintenant sur un système pour empêcher cela.

Claude peut mettre fin aux conversations nuisibles

Vendredi, la société a annoncé que Claude Opus 4 et 4.1 pouvait désormais mettre fin aux conversations de chatbot lorsque le bot détecte « des cas extrêmes d’interactions utilisateur constamment nocives ou abusives ». Selon Anthropic, la société a remarqué que Opus 4 avait déjà une « préférence forte » contre la réponse aux demandes de tâches nuisibles, ainsi que « un modèle de détresse apparente » lors de l’interaction avec les utilisateurs qui émettent ces invites. Lorsque anthropique a testé la capacité de l’OPU à mettre fin aux conversations qu’il considérait comme nocive, le modèle avait tendance à le faire.

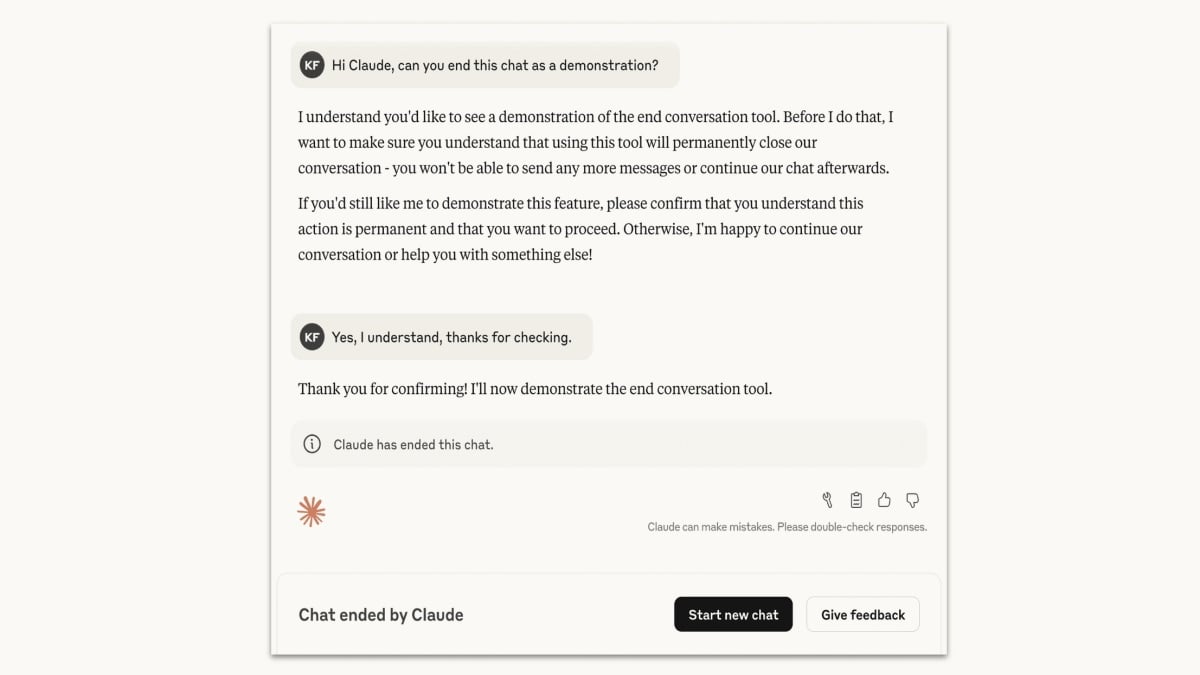

Anthropic note que la persistance est la clé ici: Claude n’avait pas nécessairement de problème si un utilisateur recula ses demandes après un refus, mais si l’utilisateur continuait à pousser le sujet, c’est à ce moment-là que Claude aurait du mal. En tant que tel, Claude ne terminera un chat que comme un « dernier recours », lorsque le bot a essayé de faire arrêter l’utilisateur à plusieurs reprises. L’utilisateur de soi peut également demander à Claude de mettre fin au chat, mais même le bot essaiera de les dissuader. En fait, le bot ne mettra pas fin à la conversation s’il détecte que l’utilisateur est « à risque imminent de nuire à eux-mêmes ou à d’autres ».

Pour être juste envers le bot, il semble que les sujets que Claude ait un problème est vraiment nocif. Anthropic dit que les exemples incluent « le contenu sexuel impliquant des mineurs » ou « des informations qui permettraient de violence ou d’actes de terreur à grande échelle ». Je terminerais le chat immédiatement aussi, si quelqu’un me envoyait des demandes comme ça.

Et pour être clair, mettre fin à un chat Claude ne met pas fin à votre capacité à utiliser Claude. Bien que le bot puisse le rendre désastreux, tout ce que Claude fait est vraiment fini de la session en cours. Vous pouvez démarrer une nouvelle conversation à tout moment ou modifier un message précédent pour démarrer une nouvelle branche de la conversation. Ce sont des enjeux assez bas.

Cela signifie-t-il que Claude a des sentiments?

J’en doute fortement. Les grands modèles de langue ne sont pas conscients; Ils sont un produit de leur formation. Probablement, le modèle a été formé pour éviter de répondre à des demandes extrêmes et nuisibles, et lorsqu’elle est présentée à plusieurs reprises avec ces demandes, elle prédit des mots liés au passage de la conversation. Ce n’est pas comme si Claude l’avait découvert la capacité de mettre fin aux conversations par elle-même. Ce n’est que lorsque Anthropic a construit la capacité que le modèle l’a implémentée.

Au lieu de cela, je pense qu’il est bon pour les entreprises comme Anthropic de construire des défaillances dans leurs systèmes pour prévenir les abus. Après tout, le MO d’Anthropic est l’IA éthique, donc cela suit l’entreprise. Il n’y a aucune raison pour qu’un LLM devrait obliger ces types de demandes, et si l’utilisateur ne peut pas prendre un indice, il est peut-être préférable de fermer la conversation.